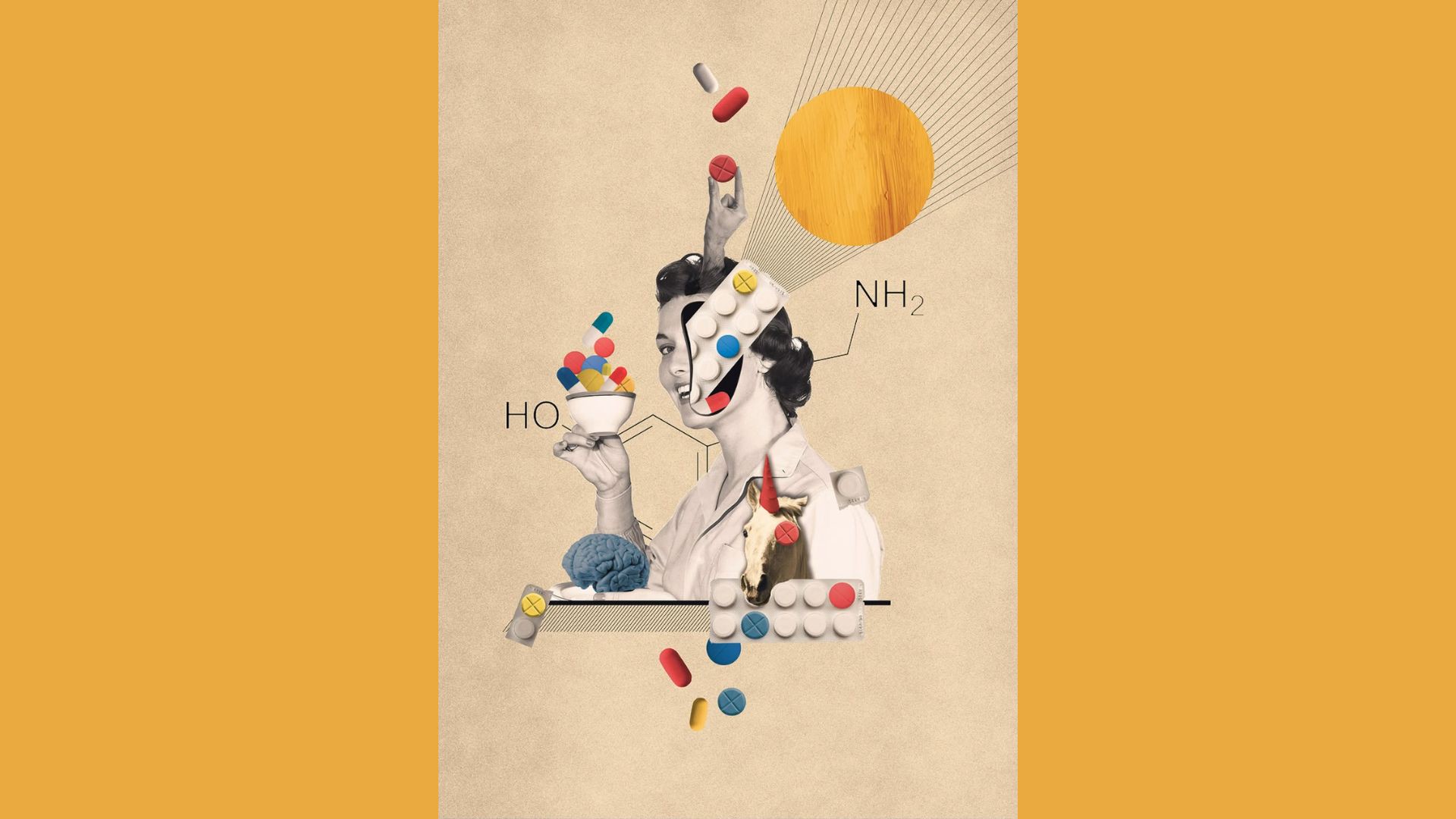

Chatbot AI có đang hiểu sai về sức khỏe của phụ nữ?

Không ít phụ nữ rời bệnh viện với cảm giác rằng triệu chứng của mình chưa được lắng nghe đầy đủ. Có người được giải thích đó chỉ là căng thẳng hay mệt mỏi, trong khi nhiều người khác phải mất nhiều năm mới được chẩn đoán chính xác các bệnh như lạc nội mạc tử cung hoặc rối loạn tăng động giảm chú ý (ADHD).

Trong bối cảnh đó, ngày càng nhiều người tìm đến các chatbot trí tuệ nhân tạo (AI) như một “bác sĩ thứ hai” để hỏi về những điều mà họ cảm thấy chưa được giải đáp.

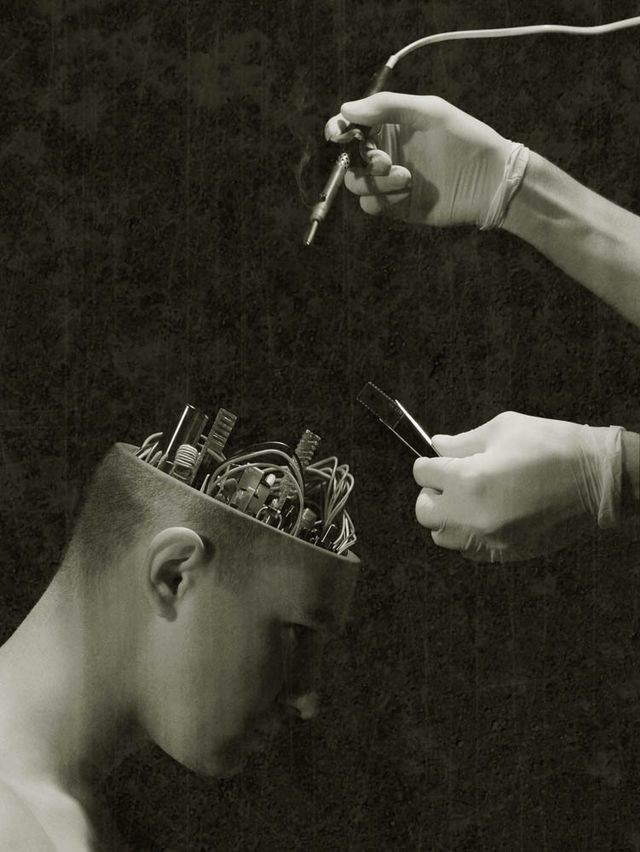

Tuy nhiên, khi các chatbot AI được xây dựng từ những dữ liệu y khoa chủ yếu dựa trên nghiên cứu ở nam giới, các hệ thống này cũng có nguy cơ hiểu chưa đầy đủ về sức khỏe phụ nữ và lặp lại những thiên kiến đã tồn tại trong hệ thống y tế.

AI không thể thay thế bác sĩ

Những năm gần đây, các chatbot AI đang nhanh chóng trở thành một công cụ phổ biến trong việc tìm kiếm thông tin sức khỏe. Theo OpenAI, hơn 230 triệu người trên thế giới đặt câu hỏi liên quan đến sức khỏe trên ChatGPT mỗi tuần, khiến các câu hỏi về sức khỏe trở thành một trong những nội dung phổ biến nhất trên chatbot này. Gần đây, công ty đã giới thiệu ChatGPT Health - tính năng cho phép người dùng tải hồ sơ y tế cá nhân lên hệ thống để phân tích dữ liệu sức khỏe. Tuy nhiên, OpenAI nhấn mạnh công cụ này chỉ nhằm hỗ trợ người dùng hiểu rõ hơn về tình trạng của mình chứ không thay thế bác sĩ.

Theo bác sĩ Kasim Usmani, y học lâm sàng không chỉ dựa vào dữ liệu mà còn phụ thuộc vào việc thăm khám trực tiếp và đánh giá bối cảnh cá nhân của bệnh nhân. Những yếu tố như ngôn ngữ cơ thể, biểu cảm hay giọng nói là các tín hiệu quan trọng mà AI khó có thể nhận diện đầy đủ.

Dữ liệu về phụ nữ còn hạn chế

Một trong những lo ngại lớn nhất về AI trong y tế là lượng dữ liệu về phụ nữ còn hạn chế. Theo bà Zehra Chatoo, nhà sáng lập Code for Good Now, tổ chức hướng đến thu hẹp khoảng cách giới trong lĩnh vực AI, phụ nữ hiện sử dụng AI ít hơn nam giới khoảng 20 - 22%, khiến lượng dữ liệu về họ trong các hệ thống này trở nên hạn chế.

Tuy nhiên, nguyên nhân sâu xa hơn nằm ở chính dữ liệu y khoa đã được tích lũy trong các thập kỷ qua, khi nhiều nghiên cứu lâm sàng được thực hiện chủ yếu trên nam giới. Cơ thể nam giới thường được xem là “mặc định” trong nghiên cứu khoa học, trong khi cơ thể phụ nữ, với các yếu tố như hormone, chu kỳ kinh nguyệt hoặc mang thai, thường bị coi là quá phức tạp để đưa vào thử nghiệm.

Hệ quả là nhiều bệnh lý có biểu hiện khác nhau giữa nam và nữ nhưng lại được nghiên cứu chủ yếu ở nam giới. Theo Liên viện Sức khỏe Quốc gia (National Institutes of Health - NIH) của Mỹ, một ví dụ điển hình là bệnh nhồi máu cơ tim. Các triệu chứng “kinh điển” của bệnh này như đau thắt ngực lan xuống cánh tay trái chủ yếu dựa trên mô tả ở nam giới, trong khi phụ nữ có thể trải qua những dấu hiệu khác như buồn nôn, mệt mỏi cực độ hoặc đau lưng.

Khi các hệ thống AI được xây dựng trên những dữ liệu như vậy, các chatbot cũng có thể lặp lại những hạn chế vốn đã tồn tại trong nghiên cứu y khoa.

Lặp lại những thiên kiến cũ

Một nghiên cứu của Trường Kinh tế và Khoa học Chính trị London (LSE) cho thấy nhu cầu chăm sóc sức khỏe của phụ nữ đôi khi bị đánh giá thấp trong các hệ thống AI. Theo báo Guardian, khi các nhà nghiên cứu sử dụng AI để tóm tắt cùng một hồ sơ bệnh nhân nhưng chỉ thay đổi giới tính, cách công cụ này mô tả tình trạng bệnh cũng khác nhau.

Các từ khóa mô tả như “khuyết tật” hay “tình trạng phức tạp” xuất hiện thường xuyên hơn khi hệ thống nói về bệnh nhân nam. Trong khi đó, với cùng dữ liệu, bệnh nhân nữ lại được mô tả nhẹ hơn. Những khác biệt nhỏ trong ngôn ngữ này có thể ảnh hưởng đến cách hệ thống đánh giá mức độ nghiêm trọng của bệnh nhân và mức độ chăm sóc mà bệnh nhân nhận được.

Nguy cơ này phần nào bắt nguồn từ những bất cập vốn đã tồn tại trong hệ thống y tế. Trong nhiều năm qua, không ít phụ nữ đã báo cáo trải nghiệm mà các nhà nghiên cứu gọi là “medical gaslighting”, khi triệu chứng của họ bị xem nhẹ hoặc bị quy cho căng thẳng hay yếu tố tâm lý, theo báo Independent. Nếu AI được xây dựng dựa trên những dữ liệu như vậy, nó có thể tiếp tục lặp lại những bất bình đẳng vốn đã tồn tại trong chăm sóc sức khỏe.

AI: Thách thức nhưng cũng là cơ hội

Tuy vậy, không phải ai cũng nhìn nhận AI trong y tế theo hướng tiêu cực. Nhiều chuyên gia cho rằng vấn đề không nằm ở bản thân công nghệ mà ở cách con người thiết kế và sử dụng nó.

Nếu được xây dựng cẩn thận với những nguồn dữ liệu đa dạng và đầy đủ hơn, AI thậm chí có thể giúp giảm bớt những bất bình đẳng trong chăm sóc sức khỏe. Các hệ thống phân tích dữ liệu lớn có thể giúp phát hiện sự khác biệt giới trong bệnh lý, hỗ trợ chẩn đoán sớm những bệnh thường bị bỏ sót ở phụ nữ, hoặc giúp các nhà nghiên cứu nhận ra những khoảng trống còn tồn tại trong tri thức y khoa.

Trên thực tế, một số dự án hiện nay đã bắt đầu tập trung phát triển AI trong chăm sóc sức khỏe phụ nữ (femtech AI), với mục tiêu xây dựng các mô hình được đào tạo trên dữ liệu đại diện hơn cho phụ nữ.

Công nghệ phản chiếu xã hội

Những câu hỏi về thiên kiến của AI cũng dẫn đến một vấn đề rộng hơn, khi công nghệ không tồn tại tách rời xã hội. Những hệ thống mà con người tạo ra, từ thuật toán cho đến trí tuệ nhân tạo, thường phản ánh những cấu trúc và bất bình đẳng đã tồn tại trước đó.

Trong lĩnh vực y học, điều này có nghĩa là nếu dữ liệu lịch sử chứa những khoảng trống hoặc thiên lệch, AI có thể tiếp tục lặp lại chúng. Nhưng đồng thời, công nghệ này cũng mở ra một cơ hội, giúp con người nhìn thấy những bất bình đẳng đó rõ ràng hơn bao giờ hết.

Vì vậy, thay vì coi AI là một công cụ hoàn toàn khách quan, nhiều nhà nghiên cứu cho rằng nó giống như một "tấm gương" phản chiếu xã hội. Khi dữ liệu y khoa còn những khoảng trống, AI có thể lặp lại chúng nhưng đồng thời cũng giúp con người nhận ra những bất bình đẳng đó rõ ràng hơn. Và đôi khi, chính những điều mà “tấm gương” đó cho thấy lại là bước đầu tiên cho sự thay đổi.